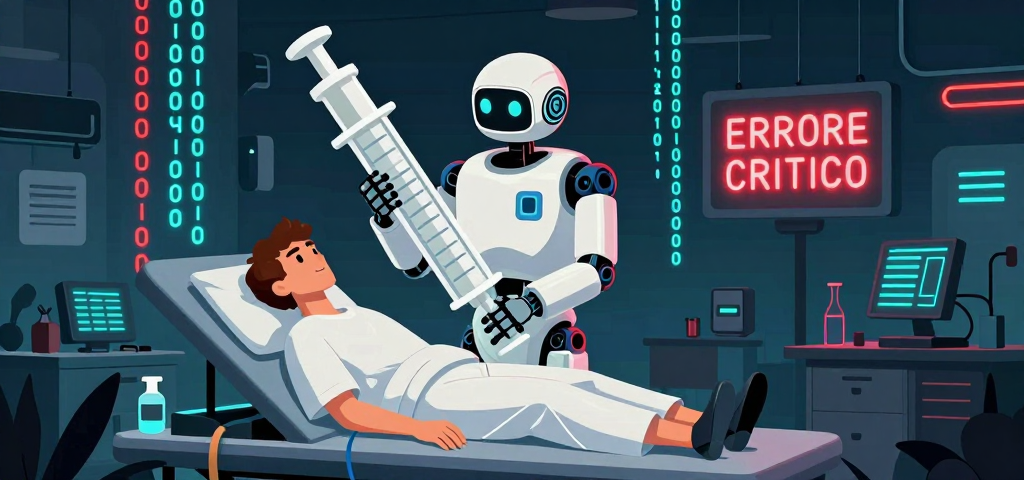

ChatGPT Health si è preso un bel voto sotto la lente d’ingrandimento: secondo uno studio, l’IA sottovaluta le emergenze mediche e fa casino con gli allarmi per il rischio suicidio. Insomma, se pensavate che Siri fosse già un disastro a dare indicazioni stradali, questa è un’altra storia.

La notizia arriva dritta dritta dal futuro (siamo nel 2026, gente, siete pronti per i cyborg?) e ci ricorda che, nonostante i progressi, l’intelligenza artificiale è ancora lontana dal sostituire un medico umano. O almeno, lo speriamo.

Ma perché questo studio è importante per noi, che passiamo le notti a programmare, smanettare e inventare cose? Innanzitutto, perché ci ricorda che anche le AI più avanzate hanno i loro limiti. E quando si parla di salute, quei limiti possono essere pericolosi.

Da smanettone, non posso fare a meno di chiedermi: quanto di questo problema è legato all’hardware, quanto al software, e quanto alla mancanza di dati di qualità? Le AI sono solo buone come i dati con cui vengono addestrate, e se quelli sono scarsi o sbilanciati, il risultato sarà altrettanto.

E poi c’è la questione dell’etica. Usare un’IA per diagnosi mediche senza supervisione umana è come affidare il tuo Raspberry Pi a un bambino di cinque anni: può funzionare per un po’, ma alla lunga qualcosa andrà storto. La tecnologia è potente, ma senza una cornice etica solida, è solo un giocattolo pericoloso.

Per noi maker e hacker, la lezione è chiara: quando lavoriamo con l’IA, dobbiamo sempre chiedere “E se…?” e testare, testare, testare. Specialmente quando si tratta di applicazioni critiche come la salute.

E voi, avete mai provato a usare un’IA per qualcosa di serio? Raccontateci le vostre esperienze nei commenti!

Source: ChatGPT Health Underestimates Medical Emergencies, Study Finds